Разработанный метод позволяет блокировать нелегальное использование моделей компьютерного зрения и идентифицировать их без переобучения и дополнительных вычислений — это может решить проблему пиратства и защиты авторских прав в эпоху искусственного интеллекта (ИИ).

Группа исследователей из Научной лаборатории ИИ, анализа данных и моделирования им. профессора А. Н. Горбаня, созданной на базе Центрального университета, разработала способ защиты моделей компьютерного зрения (нейросети для интерпретации визуальных данных) от несанкционированного использования — не прибегая к переобучению. Метод позволяет как подтвердить авторские права на модель, так и сделать ее неработоспособной без специального «ключа». Решение может стать важным шагом в коммерциализации моделей компьютерного зрения, особенно в сегментах мобильных приложений и финтехе.

Результаты исследования были представлены на Международной конференции ICCV 2025 (International Conference on Computer Vision) уровня А*1, которая прошла на Гавайях, США, с 19 по 23 октября 2025 года.

Исследование специалистов Центрального университета получило положительную оценку рецензентов, среди которых эксперты ведущих международных компаний и университетов — Amazon, Google, Yahoo!, Корнелльский университет.

Результаты исследования были представлены на Международной конференции ICCV 2025 (International Conference on Computer Vision) уровня А*1, которая прошла на Гавайях, США, с 19 по 23 октября 2025 года.

Исследование специалистов Центрального университета получило положительную оценку рецензентов, среди которых эксперты ведущих международных компаний и университетов — Amazon, Google, Yahoo!, Корнелльский университет.

Актуальность и практическая значимость

Компании все чаще разрабатывают собственные модели компьютерного зрения для внедрения в продукты: от смартфонов до бытовой техники. Как только модель устанавливается на устройство, ее можно скопировать для последующей перепродажи или использования в конкурирующем решении. В отличие от программного обеспечения, нейросети для анализа изображений сложно защитить: модели представляют собой набор чисел (весов), которые можно легко воспроизвести.

Сегодня для защиты моделей компьютерного зрения используют два подхода: водяные знаки для доказательства авторства и ключи для обеспечения работоспособности. Оба метода требуют интеграции еще на этапе обучения — это дорого, времязатратно и не подходит для готовых моделей. ф

Сегодня для защиты моделей компьютерного зрения используют два подхода: водяные знаки для доказательства авторства и ключи для обеспечения работоспособности. Оба метода требуют интеграции еще на этапе обучения — это дорого, времязатратно и не подходит для готовых моделей. ф

Суть изобретения

Исследователи Центрального университета с соавторами предложили заменить всего один нейрон в уже обученной модели компьютерного зрения на «нейрон-детектор». Это элемент, который не реагирует на обычные изображения, но активизируется, если на картинке есть специальный «раздражитель», то есть секретный ключ (например, небольшой узор 4×4 пикселя). Срабатывание нейрона-детектора подтверждает авторство модели.

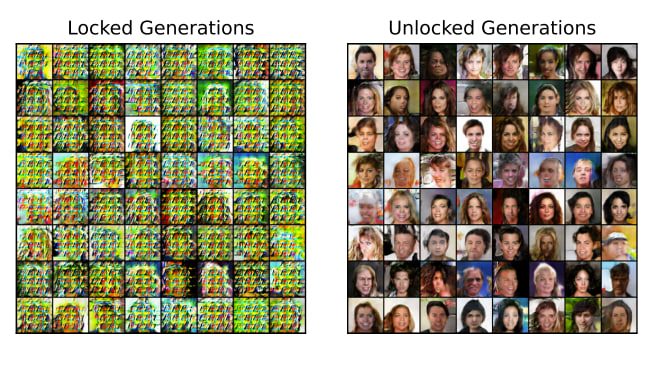

Если в обученную нейросеть для анализа изображений добавить по этому же принципу «нейроны-нарушители», модель будет работать штатно только при наличии ключа. Без него нейроны намеренно вносят помехи и препятствуют работе модели. Метод похож на лицензионный ключ, уникальный для каждого пользователя, но он уже заранее заложен в «ядро» нейросети, то есть не требует генерации на этапе обучения. Это изобретение поможет решить проблему пиратства и масштабировать защитные механизмы для моделей компьютерного зрения.

Если в обученную нейросеть для анализа изображений добавить по этому же принципу «нейроны-нарушители», модель будет работать штатно только при наличии ключа. Без него нейроны намеренно вносят помехи и препятствуют работе модели. Метод похож на лицензионный ключ, уникальный для каждого пользователя, но он уже заранее заложен в «ядро» нейросети, то есть не требует генерации на этапе обучения. Это изобретение поможет решить проблему пиратства и масштабировать защитные механизмы для моделей компьютерного зрения.

Пример работы «нейронов-нарушителей», которые вносят помехи и препятствуют работе модели

Уникальность метода:

- Математическая гарантия

- Метод не требует переобучения

- Возможность массового распространения

- Потенциал масштабирования на другие языковые модели

Глеб Рыжаков, старший научный сотрудник лаборатории ИИ, анализа данных и моделирования им. А. Н. Горбаня в Центральном университете:

«Сегодня модели искусственного интеллекта, особенно в компьютерном зрении, представляют собой результат масштабных инвестиций, как финансовых, так и интеллектуальных. Однако, в отличие от традиционных цифровых объектов, защитить модели компьютерного зрения от кражи и несанкционированного присвоения крайне сложно. Существующие методы, как правило, требуют интеграции защитных механизмов на этапе обучения, что делает их сложными в реализации на практике и почти неприменимыми для уже готовых, предобученных моделей. Наша исследовательская лаборатория разработала революционное решение, позволяющее встроить защиту в модель без необходимости ее переобучения. Простота, масштабируемость и теоретически обоснованная надежность такого подхода создают основу для противодействия воровству в сфере ИИ — а это актуальная проблема для разработчиков и исследователей по всему миру».

1 Согласно международной системе, которая ранжирует крупные конференции по computer science, конференции типа A* — это конференции высшего уровня, во внимание берется цитируемость статей, процент принятых публикаций, авторитет участников и экспертность организаторов. Конференции уровня A* считаются лучшими и наиболее престижными в мировой науке.

Ознакомиться с научной статьей можно по ссылке

Ознакомиться с научной статьей можно по ссылке